Professional Documents

Culture Documents

Box Jenkins

Uploaded by

Vsqz KellyCopyright

Available Formats

Share this document

Did you find this document useful?

Is this content inappropriate?

Report this DocumentCopyright:

Available Formats

Box Jenkins

Uploaded by

Vsqz KellyCopyright:

Available Formats

MODELOS ARIMA

Mayo 2001

Prof. Rafael de Arce

Prof. Ramn Maha

Dpto. Economa Aplicada

U.D.I. Econometra e Informtica

ADE Econometra II. Modelos de Series Temporales

Pgina 2

___________________________________________________________________________________

INTRODUCCIN

En 1970, Box y Jenkins desarrollaron un cuerpo metodolgico destinado a identificar, estimar y

diagnosticar modelos dinmicos de series temporales en los que la variable tiempo juega un papel

fundamental. Una parte importante de esta metodologa est pensada para liberar al investigador

econmetra de la tarea de especificacin de los modelos dejando que los propios datos temporales de

la variable a estudiar nos indiquen las caractersticas de la estructura probabilstica subyacente. En

parte, los procedimientos que vamos a analizar se contraponen a la "forma tradicional" de identificar y

especificar un modelo apoyndonos en las teoras subyacentes al fenmeno analizado aunque,

convenientemente utilizados, los conceptos y procedimientos que examinaremos constituyen una

herramienta til para ampliar y complementar los conocimientos economtricos bsicos.

Se comenzar analizando los modelos en los que una variable es explicada utilizando

exclusivamente una "exgena": su propio pasado. Podemos decir que la consideracin exclusiva de los

valores pasados de una determinada variable para explicar su evolucin presente y futura supone, al

mismo tiempo, una ventaja y un inconveniente:

- la ventaja radica en el hecho de no necesitar distintas series de datos (distintas variables)

referidas al mismo perodo de tiempo (caracterstica comn a todos los modelos univariantes) y, al

mismo tiempo, ahorrarnos la identificacin y especificacin del modelo en el sentido de la econometra

tradicional,

- el inconveniente es que, al renunciar a la inclusin de un conjunto ms amplio de variables

explicativas, no atendemos a las relaciones que sin duda existen entre casi todas las variables

econmicas perdiendo capacidad de anlisis al tiempo que renunciamos, implcitamente, al estudio

terico previo del fenmeno y a su indudable utilidad.

Dentro de estos modelos univariantes se desarrollarn suficientemente los conocidos con el

nombre de ARIMA. Posteriormente se complementar esta perspectiva univariante aadindose a la

especificacin una o ms variables exgenas al modelo "tradicional" aproximndonos al estudio de los

conocidos como modelos de transferencia.

Como es habitual en economa, definiremos una estructura que nos permita, por sus

caractersticas, cumplir el fin ltimo de prediccin: proceso estocstico estacionario. Diremos cuales

son las condiciones que ha de cumplir esta funcin para que podamos calcularla y definiremos el

proceso estocstico estacionario lineal y discreto. Posteriormente, analizaremos los modelos ms

simples (que emplean menos retardos) conforme a una serie de funciones caractersticas (covarianza,

autocorrelacin total y autocorrelacin parcial), describiendo sus condiciones y planteando estructuras

tericas que luego puedan ser identificables con series temporales reales.

DEFINICIN Y CONCEPTOS BSICOS DE LOS MODELOS ARIMA

Proceso estocstico y estacionariedad

Los modelos autorregresivos o de medias mviles que ms tarde conceptualizaremos

necesitan para su comprensin de la introduccin del concepto de proceso estocstico.

Un proceso estocstico es una sucesin de variables aleatorias Yt ordenadas,pudiendo tomar t

cualquier valor entre - y . Por ejemplo, la siguiente sucesin de variables aleatorias puede ser

considerada como proceso estocstico:

Pgina 3

ADE Econometra II. Modelos de Series Temporales

___________________________________________________________________________________

Y -5 , y -4 , y -3 , y -2 ,........ y 3 , y 4

El subndice t no tiene, en principio, ninguna interpretacin a priori, aunque si hablamos de

proceso estocstico en el contexto del anlisis de series temporales este subndice representar el paso

del tiempo.

Cada una de las variables Yt que configuran un proceso estocstico tendrn su propia funcin

de distribucin con sus correspondientes momentos. As mismo, cada par de esas variables tendrn su

correpondiente funcin de distribucin conjunta y sus funciones de distribucin marginales. Esto

mismo ocurrir, ya no para cada par de variables, sino para conjuntos ms amplios de las mismas. De

esta forma, para caracterizar un proceso estocstico deberamos especificar las funciones de

distribucin conjunta de cualquier conjunto de variables:

( Y t 1 ,Y t 2 ,Y t 3 ,....Y t m )

cualesquiera que fueran los valores de (t1, t2,....tm) y cualquiera que fuera el valor de m; por ejemplo:

y1 , y 2 , y 3 ( t 1 = 1 y m = 3)

Y 3 , y 4 , y 5 , y 6 ( t 1 = 3 y m = 4)

Habitualmente, conocer esas funciones de distribucin resulta complejo de forma que, para

caracterizar un proceso estocstico, basta con especificar la media y la varianza para cada yt y la

covarianza para variables referidas a distintos valores de t:

E[ Y t ] = t

2

2

t = Var( y t ) = E[ y t - t ]

t = Cov(Y y ,Y s ) = E[( y t - t )( y s - s )]

Las distribuciones de probabilidad podran no estar completamente caracterizadas en algunas

de las variables, los momentos podran no coincidir incluso no existir para alguna de las variables

aleatorias, lo mismo puede ocurrir con las distribuciones conjuntas o marginales. Sin embargo, de todos

los tipos de procesos estocsticos posibles, nos interesan especialmente dos de ellos a los que la

estadstica ha dado nombres precisos:

- ruido blanco es una sucesin de variables aleatorias (proceso estocstico) con esperanza

(media) cero, varianza constante e independientes para distintos valores de t (covarianza nula).

- proceso estocstico estacionario.

ADE Econometra II. Modelos de Series Temporales

Pgina 4

___________________________________________________________________________________

Decimos que un proceso estocstico es estacionario si las funciones de distribucin conjuntas

son invariantes con respecto a un desplazamiento en el tiempo (variacin de t). Es decir, considerando

que t, t+1, t+2, ...., t+k reflejan perodos sucesivos:

F( Y t ,Y t +1 ,.....Y t +k ) = F( Y t+m ,Y t +1+m ,.....,Y t +k+m )

para cualquier t, k y m; por ejemplo:

F( y1 , y 2 ,......, y 6 ) = F( y 10 ,Y 11 ,..... y15 )

donde t = 1 ,k = 5 , m = 9

F( y3 ,Y 4 ,Y 5 ) = F( y7 ,Y 8 ,Y 9 )

donde t = 3 ,k = 2 , m = 4

Esta definicin de estacionariedad se conoce como estacionariedad en sentido estricto o

fuerte y puede relajarse sustancialmente utilizando la denominada estacionariedad en sentido

amplio o dbil. Decimos que un proceso estocstico es dbilmente estacionario si:

- Las esperanzas matemticas de las variables aleatorias no dependen del tiempo, son

constantes:

E[ Y t ] = E[ Y t +m ] m

- Las varianzas tampoco dependen del tiempo y son finitas:

Var[ Y t ] = Var[ Y t +m ] m

- Las covarianzas entre dos variables aleatorias del proceso correspondientes a perodos

distintos de tiempo (distintos valores de t) slamente dependen del lapso de tiempo

transcurrido entre ellas:

Cov(Y t ,Y s ) = Cov(Y t +m ,Y s+m ) m

De esta ltima condicin se desprende que, si un fenmeno es estacionario, sus variables

pueden estar relacionadas linealmente entre si, pero de forma que la relacin entre dos variables slo

depende de la distancia temporal k transcurrida entre ellas.

Lgicamente, la estacionariedad en sentido estricto grantiza la estacionariedad en sentido

amplio pero no al revs.

ADE Econometra II. Modelos de Series Temporales

Pgina 5

___________________________________________________________________________________

Una vez introducido el concepto genrico de proceso estocstico puede decirse que una serie

temporal cualquiera es, en realidad, una muestra, una realizacin concreta con unos valores concretos

de un proceso estocstico terico, real. El anlisis de series que vamos a estudiar tratar, a partir de

los datos de una serie temporal, inferir las caractersticas de la estructura probabilstica subyacente,

del verdadero proceso estocstico.

Modelos autorregresivos

La palabra ARIMA significa Modelos Autorregresivos Integrados de Medias Mviles.

Definimos un modelo como autorregresivo si la variable endgena de un perodo t es

explicada por las observaciones de ella misma correspondientes a perodos anteriores aadindose,

como en los modelos estructurales, un trmino de error. En el caso de procesos estacionarios con

distribucion normal, la teora estadstica de los procesos estocsticos dice que, bajo determinadas

condiciones previas, toda Yt puede expresarse como una combinancin lineal de sus valores pasados

(parte sistemtica) ms un trmino de error (innovacin).

Los modelos aotorregresivos se abrevian con la palabra AR tras la que se indica el orden del

modelo: AR(1), AR(2),....etc. El orden del modelo expresa el nmero de observaciones retasadas de

la series temporal analizada que intervienen en la ecuacin. As, por ejemplo, un modelo AR(1) tendra

la siguiente expresin:

Y t = 0 +1 Y t -1 + at

El trmino de error de los modelos de este tipo se denomina generalmente ruido blanco

cuando cumple las tres hiptesis bsicas tradicionales mencionadas al principio del texto:

- media nula

- varianza constante

- covarianza nula entre errores correspondientes a observaciones diferentes

La expresin genrica de un modelo autorregresivo, no ya de un AR(1) sino de un AR(p)

sera la siguiente:

Y t = 0 +1 Y t -1 + 2 Y t - 2 + ......+ p Y t - p + at

pudindose escribir de forma abreviada como:

p (L)Y t = 0 + at

donde p(L) es lo que se conoce como operador polinomial de retardos:

p (L) = 1 - 1 L - 2 L2 - ...... - p L p

Pgina 6

ADE Econometra II. Modelos de Series Temporales

___________________________________________________________________________________

y donde, a su vez, el trmino L es lo que se conoce como operador retardo tal que, aplicado al valor de

una variable en t, d como resultado el valor de esa misma variable en t-1:

LYt=Yt-1

y aplicado sucesivamente p veces retarda el valor en p perodos

Lp Yt=Yt-p

Normalmente, se suele trabajar con modelos autorregresivos de rdenes bajos: AR(1) o

AR(2), o bien con rdenes coincidentes con la periodicidad de los datos de la serie analizada (si es

trimestral AR(4), si es mensual AR(12)....).

Modelo de medias mviles

Un modelo de los denominados de medias mviles es aquel que explica el valor de una

determinada variable en un perodo t en funcin de un trmino independiente y una sucesin de

errores correspondientes a perodos precedentes, ponderados convenientemente. Estos modelos se

denotan normalmente con las siglas MA, seguidos, como en el caso de los modelos autorregresivos,

del orden entre parntesis. As, un modelo con q trminos de error MA(q) respondera a la siguiente

expresin:

Y t = + at + 1 a t -1 + 2 a t -2 + ....+ q at -q

que de nuevo puede abreviarse utilizando el polinomio de retardos (como en en caso de los modelos

AR):

Y t = q (L) at +

Al igual que en el caso de los modelos autorregresivos, el orden de los modelos de medias

mviles suele ser bajo MA(1), MA(2) o corresponderse con la periodicidad de los datos analizados

MA(4), para series trimestrales, o MA(12) para series mensuales.

Interpretacin de un modelo de medias mviles

As como un modelo autorregresivo es intuitivamente sencillo de comprender, la formulacin

de un modelo de medias mviles resulta sorprendente para el no iniciado. Qu significa que una

variable aleatoria se explique en funcin de los errores cometidos en perodos precedentes?, De

dnde proceden esos errores?, Cul es la justificacin de un modelo de este tipo?.

En realidad, un modelo de medias mviles puede obtenerse a partir de un modelo

autorregresivo sin ms que realizar sucesivas sustituciones.

Efectivamente, un modelo AR(1), sin trmino independiente, tiene la expresin:

Pgina 7

ADE Econometra II. Modelos de Series Temporales

___________________________________________________________________________________

Y t = Y t -1 + a t

si consideramos t-1 en lugar de t el modelo sera en este caso:

Y t -1 = Y t - 2 + at -1

y sustituyendo queda:

Y t = a t + a t -1 + Y t -2

2

si ahora sustituimos yt-2 por su expresin autorregresiva y as sucesivamente llegamos a un modelo del

tipo:

Y t = a t + a t -1 + at -2 + a t -3 + .... + a t - j + ....

2

que es la expresin, sin trmino independiente, de un modelo de medias mviles como el planteado

anteriormente. En realidad, de forma estricta, el paso de un modelo a otro debera realizarse al

contrario (de un MA a un AR) utilizando el teorema general de descomposicin de Wold.

Condiciones y races unitarias para los modelos AR y MA

Hemos dicho anteriormente que, bajo condiciones generales, todo proceso estocstico

estacionario se prestaba a una especificacin tipo AR(p) y en consecuencia poda expresarse tambin

como un MA(q). Es ahora el momento de especificar lo que antes hemos llamado "condiciones

generales" y examinar en que casos es posible la realizacin de un proceso AR MA para

representar un proceso estocstico estacionario.

Para que un proceso estocstico estacionario admita una formulacin del tipo que aqu

estudia remos han de cumplirse dos condiciones accesorias:

el proceso no debe ser anticipante (hiptesis de recursividad temporal); lo que quiere decir

que los valores de una variable en un momento t no dependern de los que esta misma tome en t+j,

siendo jota cualquier valor superior a cero.

el proceso ha de ser invertible; lo que supone que la correlacin entre una variable y su pasado

va reducindose a medida que nos alejamos ms en el tiempo del momento para el que estamos

considerando dicha correlacin (proceso ergdico). La explicacin intuitiva de esta situacin

derivara de que si el especificramos una variable en funcin de ciertos coeficientes que nos

determinen su correlacin con los valores pasados de ella misma, los valores de dichos coeficientes

deberan ser necesariamente inferiores a uno, porque sino el proceso de infinitos nmeros sera

"explosivo".

Pgina 8

ADE Econometra II. Modelos de Series Temporales

___________________________________________________________________________________

La estacionariedad de las series temporales en la realidad

Queda clara que la aproximacin a los procesos estocsticos con modelos AR o MA est

restringida, en trminos generales, a aquellos procesos estocsticos que cumplan, al menos de forma

dbil, la restriccin de estacionariedad. Cuando, en la realidad, queremos inferir a partir de una serie

temporal (muestra) la estructura del proceso estocstico mediante modelos AR MA, debemos cubrir

dos etapas:

- asegurarnos de que la serie temporal, como muestra del proceso estocstico, es estacionaria

y, si no lo es,

- transformar la serie temporal original de forma que la nueva serie transformada si lo sea.

a) cmo verificamos si la serie a analizar es estacionaria en media? cmo lograr

que lo sea? Filtrado de la serie original

Para resolver la primera cuestin existen diversos mtodos de aproximacin y, de entre ellos,

destacamos Podramos subdividir la serie temporal en varios perodos de, aproximadamente, la misma

longitud, y calcular su media. El proceso sera estacionario en el caso en que dichos estadsticos

fueran prcticamente iguales para todos los subperodos analizados. En la mayora de los casos, un

simple grfico sirve para observar si existe o no una clara tendencia y, por tanto, si la serie es

estacionaria o no.

Habitualmente, cuando una serie muestra tendencia, se subdivide dicha serie en dos

componentes: una primera, la estimacin de dicha tendencia, y, la segunda, el residuo o error que se

comete cuando se utiliza dicha tendencia como valor estimado de la serie original.

y t = Tt + rt

Una vez estimada la tendencia, aproximada con una regresin lineal, parablica, exponencial

... que sea ms conveniente; trabajaremos con la serie del residuo, que entonces no mostrara

tendencia y podremos decir que es estacionaria en media. Es sobre este residuo sobre el que

llevaremos a cabo todo el proceso descrito como metodologa de identificacin ARIMA, sumando

finalmente el valor de la tendencia estimada si queremos dar resultados de estimacin de la serie

original. Es decir:

1.- la identificacin del proceso ARIMA se har sobre esta serie del residuo rt = yt Tt , estimada

previamente la tendencia del modo ms adecuado.

2.- Para obtener valores estimados de la serie original, sumaremos el componente tendencial al valor

estimado del residuo mediante el modelo ARIMA y t = Tt + rt .

A este procedimiento se le conoce con el nombre de filtrado de la tendencia de la serie. Por supuesto,

existen muy variadas formas de aplicar un filtro, siendo la que aqu hemos enunciado la ms sencilla.

b) Cmo se comprueba si una serie es estacionaria en varianza? Orden de

integracin

Sin duda alguna, el test ms habitual a la hora de determinar la estacionariedad de una serie

temporal, consiste en la aplicacin del conocido como test de DickeyFuller (Test DF) o Dickey-Fuller

Pgina 9

ADE Econometra II. Modelos de Series Temporales

___________________________________________________________________________________

Ampliado (Test ADF). ste es un contraste de No estacionariedad ya que la hiptesis nula es

precisamente la presencia de una raz unitaria en el proceso generador de datos de la serie analizada.

Vamos a suponer inicialmente, como modelo de partida para el anlisis de una determinada

serie yt, el de un proceso estacionario autorregresivo de orden uno:

y t = a1 yt 1 + t

(Ec. 1)

frente a este modelo se plantea, como hiptesis nula H0, el modelo alternativo de un paseo

aleatorio no estacionario del tipo1:

y t = y t 1 + t

se trata por tanto de contrastar si el coeficiente a1 es igual a la unidad o distinto de ella.

Sin embargo, para contrastar la nulidad del coeficiente a1, no podemos utilizar el

contraste t habitual sobre una estimacin por MCO del primer modelo. La razn es que la

hiptesis nula que habitualmente se contrasta y, a partir de la cual se deriva la expresin y propiedades

del test t, es la de nulidad del parmetro (a1=0) de la (Ec.2), sin embargo, en nuestro caso,

necesitaramos contrastar H0: a1=1. Si la hiptesis nula fuera cierta, la varianza de yt no sera

estacionaria sino que crecera con los valores de t segn la expresin de la varianza de un paseo

aleatorio con deriva:

Var( y t ) = t 2

La estimacin de a1 en y t = a1 y t 1 + t ser siempre consistente sin embargo, su distribucin

variar segn los valores que tome la estimacin. Utilizando las palabras de Novales (1993), la

distribucin de probabilidad asinttica del estimador de MCO del modelo AR(1) presenta una

discontinuidad cuando a1=1 y, como sustituto, debern utilizarse las distribuciones derivadas de

forma emprica mediante un procedimiento de Montecarlo realizado por Dickey (1976). Ms

recientemente, MacKinnon (1991) realiz un nmero mayor de simulaciones que las tabuladas por

Dickey y Fuller. Adems, MacKinnon estim la superficie de respuesta usando los resultados de la

simulacin, lo que permite calcular los valores crticos del test DF para cualquier tamao muestral y

cualquier nmero de variables en el lado derecho de la ecuacin.

En la prctica, por cuestiones de sencillez operativa, el modelo utilizado para el contraste DF no es el

expuesto al comienzo del epgrafe sino otro, equivalente al anterior, que se obtiene restando a uno y

otro lado el trmino yt-1:

y t = y t 1 + t yt = t en un proceso de este tipo, sustituyendo recursivamente se obtiene:

t

t

y t = y 0 + i , proceso con media constante E[ y t ] = E y 0 + i = E[ y 0 ] = y 0 y varianza

i =1

i =1

t

V [ y t ] = E[ y t E [ y t ]] = E y 0 + i y 0 = E i =

estocstica:

i =1

i =1

2

2

2

2

= E 1 + 2 ..... + 1 2 + 1 3 + ..... = E 1 + 2 .... + t2 = t2

2

Pgina 10

ADE Econometra II. Modelos de Series Temporales

___________________________________________________________________________________

y t y t 1 = a0 + a1 y t 1 yt 1 + t

y t = a0 + ( a1 1) y t 1 + t

y t = a0 + yt 1 + t

(Ec. 2)

por tanto, la hiptesis nula inicial para la (Ec. 2), se transforma ahora en H0: =0 frente a H1:

<0. Decir que es nulo es lo mismo que decir que a1=1, o sea, que existe una raz unitaria, decir que

es menor que cero equivale a decir que a1 es menor que la unidad (proceso autorregresivo

estacionario) 2.

El procedimiento bsico para la aplicacin simple del test DF es, a partir de aqu,

aparentemente sencillo. Se estima el modelo propuesto y se calcula el valor estimado de la t del

parmetro analizado. Una vez calculado se compara con el valor emprico de referencia obtenido con

las tablas de Dickey y Fuller o de MacKinnon. Si el valor estimado para es inferior en valor absoluto

al tabulado dado un determinado nivel de confianza, admitiremos la hiptesis nula, o sea, la presencia

de una raz unitaria.

El modelo expuesto hasta el momento es el ms simple posible, pero cabe que el modelo ms

adecuado a la realidad incluya otros trminos, como una constante y/o una tendencia. Dolado et al.

(1990) y Perron (1990) propusieron, entre otros autores, seguir un proceso en etapas a fin de

garantizar el xito en la eleccin del modelo de referencia en el mayor nmero de ocasiones:

En primer lugar se estimara el modelo menos restringido (con trmino constante y

tendencia determinista).

Dado que el principal error de esta tctica inicial consistira en la escasa potencia del

contraste para el rechazo de la hiptesis nula por inclusin de variables irrelevantes, si los

valores crticos indican rechazo (ausencia de raz unitaria), terminaramos el

procedimiento.

En el caso de no rechazarse la hiptesis nula de presencia de una raz unitaria, es decir, en

el caso en que admitamos la presencia de una raz unitaria (H0: =0) pasaramos ahora a

examinar la significatividad del parmetro tendencial determinista a2. Dado que, en este

punto, estaramos bajo la hiptesis ya admitida de que =0, utilizaramos el valor de

referencia de e incluso, para mayor seguridad, tambin el contraste conjunto 3

(a2==0).

Si el trmino tendencial resulta significativo (a2 0) contrastaremos de nuevo la presencia

de una raz unitaria (H0: =0) pero utilizando entonces las tablas de una normal

estandarizada. Sea cual sea el resultado del test con las nuevas tablas finalizaramos aqu

el contraste admitiendo o rechazando la presencia de una raz unitaria.

Si el trmino tendencial es no significativo, deber replantearse el modelo inicialmente

estimado pasndose a examinar otro con trmino constante pero sin esta tendencia

determinista. Con este modelo se vuelve a analizar la presencia de una raz unitaria (=0).

En el caso en que, nuevamente, se sostenga la presencia de una raz unitaria, se

contrastar entonces la adecuacin del trmino independiente a0 bien con el contraste ,

bien con 1. Si el trmino independiente resulta significativo usamos de nuevo las tablas de

No se considera el caso de procesos autorregresivos explosivos en que a1>1

Pgina 11

ADE Econometra II. Modelos de Series Temporales

___________________________________________________________________________________

una normal para contrastar la presencia de la raz unitaria, concluyendo de nuevo aqu el

contraste.

-

Slo si entonces la constante a0 es no significativa se utiliza el modelo ms simple como

modelo de referencia contrastndose, de nuevo, la presencia de raz unitaria. En este caso,

no tiene cabida el uso de la distribucin normal estandarizada.

Est claro que lo expuesto hasta este momento permite contrastar la presencia de una o ms races

unitarias en una determinada serie temporal para la que se supone un proceso AR(1). Sin embargo,

muchas serie temporales se ajustan ms adecuadamente a procesos autorregresivos de orden superior

AR(2) o AR(3). No parece, por tanto, muy correcto, contrastar la presencia de una o ms races

unitarias utilizando siempre la estructura de un modelo AR(1) ya que las races unitaria s pueden

aparecer tambin en estructuras ms complejas. Este problema da lugar a lo que se conoce como test

de races unitarias de Dickey-Fuller Ampliado (DFA): si se quiere contrastar la presencia de una raz

unitaria en una serie que sigue un proceso AR(p), deber aplicarse el procedimiento expuesto para el

caso simple AR(1), pero suponiendo ahora del modelo:

p

y t = a 0 + y t 1 + i y t i +1 + t

i= 2

donde:

p

= 1 ai

i =1

y:

p

i = a j

j =1

MODELO ARIMA(p,d,q) SARIMA(P,D,Q)

En su forma ms general el modelo ARIMA(p,d,q) ARIMA(P,D,Q,) S podra escribirse como:

Y T = 1 Y T -1 +2 Y T - 2 + ...+ Ps+ p +Ds+d Y T - Ps- p - sD -d +

+ +U T +1 U T -1 + ...+ Qs+q U T - sQ -q

Entendiendo que puede haber ms de un proceso generador de la serie (en la parte regular y

en la estacional) y escribiendo una combinacin de los modelos MA(q) y AR(p) que han precisado de

una serie de diferenciaciones "d" en la parte regular o "D" en la parte estacional para que fueran

estacionarios.

FUNCIONES DE UN PROCESO ESTOCSTICO ESTACIONARIO

Definido un proceso estocstico como estacionario (ya sea de forma dbil o fuerte), ya se ha

comentado que si cumple las condiciones en sentido estricto, tambin cumple las condiciones en

sentido dbil. Siendo as, el proceso estara perfectamente definido si conocieramos su media

constante (), su varianza constante () y la covarianza entre cada par de momentos diferentes en el

Pgina 12

ADE Econometra II. Modelos de Series Temporales

___________________________________________________________________________________

tiempo. Dicho sto:

La funcin de autocovarianza vendr definida por los distintos valores que tomara dicha

covarianza cuando cambiamos el lapso temporal entre las observaciones de la serie que manejamos.

Analticamente, se podra expresar como:

j = cov( yt , y t - j ) = E[( yt - )( y t - j - )]

donde, evidentemente, cuando el valor de "j" es cero, tendramos la varianza de la funcin:

0 = cov( yt , y t -0 ) = E( y t - )2 = 2

La funcin de autocorrelacin se define igualmente como:

j =

cov( y t , yt - j )

var( y t ) var( yt - j )

como nos encontramos ante un proceso definido como estacionario, la varianza es constante,

por lo que podemos escribir:

j =

j

0

La funcin de autocorrelacin de un proceso estocstico estacionario manifiesta las siguientes

propiedades:

1.- _ 0 = 1

2.- |_j| 1, ya que |j| 0

Esto asegura que el comportamiento de la funcin no sea explosivo.

3.- _ j = _-j (simetra)

dado que si un proceso es estacionario, la covarianza de dos variables aleatorias separadas por

el mismo lapso de tiempo es la misma.

4.-

lim

j infinity

j = 0 25 (proceso ergdico).

Esta ltima propiedad, que define al proceso como "ergdico", es la que posibilita inferir

valores de una serie en funcin de la informacin que sobre ella nos da su propio pasado, logrando

estimadores consistentes. Slo si se da esta propiedad, la prdida de informacin al no considerar la

influencia de los infinitos valores obtenidos en el pasado es cada vez ms escasa e, incluirlos, aadira

poca informacin para la definicin del proceso generador de datos que se intenta reproducir para

aplicar al futuro.

Adems de las dos funciones anteriores, se puede definir una tercera conocida como funcin

de autocorrelacin parcial, con el fin de tener en cuenta los valores de correlacin entre dos

variables aleatorias separadas entre si "j" perodos y en funcin de los valores intermedios entre ellas.

Es decir:

Pgina 13

ADE Econometra II. Modelos de Series Temporales

___________________________________________________________________________________

j = corr( y t , yt - j | y t -1 , y t - 2 ,..., y t - j +1 )

Si planteamos las mejores predicciones de yt e yt-j como los resultantes de plantear Mnimos

Cuadrados Ordinarios (MCO) siendo el primero de ellos del siguiente modo:

y t = 1 y t -1 + 2 yt -2 + ...+ j -1 y t - j +1

Se puede escribir la funcin de autocorrelacin parcial, si la media es nula, como:

j=

cov[( yt - y t )( y t - j - y t - j )]

var( y t - y t ) var( y t - j - y t - j )

Pudiendo demostrarse que:

j=

j - 1 j - 1 - j - 2 - ... - j -1 1

1 - 1 1 - 2 2 - ... - j -1 j -1

APLICACIN DE ESTAS FUNCIONES A MUESTRAS CONCRETAS

En este apartado se pretender especificar estimaciones de los valores que caracterizan el

proceso estacionario del tipo que se est describiendo ya no para el proceso estocstico general, sino

para una manifestacin concreta de ste traslucida en una serie temporal. Habr que estimar la media

(), para lo que usaremos la media muestral; la varianza (0) y la funcin de autocovarianza (j), para

lo que emplearemos la frmula de la covarianza muestral) y la funcin de autocorrelacin ( j).

Media muestral.

Como ya se ha dicho, el estimador =E(yt) ser la media muestral:

y=

1 T

yt

T t =1

dicho estimador cumplir dos propiedades:

a)

Insesgadez.- la esperanza de la media de la serie ser igual a

Esto se demuestra ya que:

E( y ) =

b)

1 T

1

e( y y ) = _T _ =

T t =1

T

Consistencia.- es decir, la varianza se anula cuando ampliamos la muestra a la poblacin

Pgina 14

ADE Econometra II. Modelos de Series Temporales

___________________________________________________________________________________

siendo el estimador insesgado, propiedad que se cumplir siempre que se d la siguiente condicin, que

no desarrollamos:

Funcin de autocovarianza muestral.

El estimador de j se obtendr segn la siguiente expresin:

Cj=

1 T

( y t - y )( yt - j - y )

T - j t

= j+1

que, a pesar de ser sesgado, dicho sesgo ser determinable y cada vez ms reducido segn se

aumente la muestra.

Funcin de autocorrelacin muestral.

Para su clculo se recurrir al cociente de funciones de autocovarianza del siguiente modo:

rj=

j

0

Cj

C0

El estimador para la funcin de autocorrelacin parcial a emplear se calcular segn el

mtodo recursivo de Durbin del siguiente modo:

11 = r 1

j

j+1 , j +1 =

r j +1 - ji r j +1 -i

i=1

j

1 - ji ri

i =1

ji ,i = ji - j+1 , j+1 j, j +1-i /i = 1...j

ADE Econometra II. Modelos de Series Temporales

Pgina 15

___________________________________________________________________________________

Empleando estas frmulas para los primeros casos, podremos escribir:

11 = r1

r 2 - 11 r 1

22 =

1 - 11 r1

21 = 11 - 22 r 1

r3 - 21 r 2 - 22 r 1

=

33

1 - 21 r1 - 22 r 2

31 = 21 - 33 22

32 = 22 - 33 21

PROCESO ESTOCSTICO ESTACIONARIO LINEAL DISCRETO

Vamos a definir un nuevo caso especial de un proceso estocstico que nos permita luego

intentar encontrar algo parecido en la realidad y que sea fcilmente identificable.

Se conoce por proceso estocstico estacionario lineal y discreto a aquel que puede expresarse

como:

y t = + a t + 1 a t -1 + 2 a t - 2 + ....

donde:

- es lineal porque puede escribirse como combinacin lineal de los errores.

- at es ruido blanco (esperanza y covarianza nulas y varianza constante).

- es discreto porque los lapsos temporales considerados son uniformes (no hay saltos temporales

distintos entre las variables consideradas).

El siguiente paso ser especificar las condiciones que nos aseguran que este proceso es

estacionario, es decir que tiene media y varianza constantes y que su covarianza slo vara cuando lo

hace el espacio temporal que separa las observaciones empleadas para calcularla. Para ver estas

condiciones, calcularemos los momentos de primer y segundo orden asegurando la estacionariedad en

sentido dbil.

Media constante:

Pgina 16

ADE Econometra II. Modelos de Series Temporales

___________________________________________________________________________________

E( yt ) = E( + a t + 1 at -1 + ....) = + i E( at )

i=0

/ = 1 y = k <

0

i=1

Es decir la media ser constante en la medida en que exista la segunda parte del sumando que,

al quedar multiplicada por la esperanza del "ruido blanco" ser finalmente cero, y la media quedar

igual a .

Varianza constante:

0 = E( y t - )2 = E( - 2 + a t + 1 a t -1 + 2 a t - 2 + .... )2 =

= E( a 2t + 12 at2-1 + 22 a 2t -2 + ...+ 2 1 at at -1 + 2 2 at at - 2 + ...) =

= 2a (1 + 12 + 22 + ...+ 0 + 0)) =

= 2a 2i

/ =1

0

i =0

Siendo entonces condicin necesaria para que la varianza exista que el ltimo sumatorio sea

calculable (converja).

Covarianza constante:

j = E[( yt - )( y t - j - )] =

E[( a t + 1 at -1 + 2 a t -2 + ...)( a t - j + 1 a t - j -1 + 2 at - j - 2 + ...)] =

= j E( a 2t - j + 1 j +1 E( at2- j -1 + 2 j+2 E( a 2t - j - 2 ) + ... =

a ( j + 1 j +1 + 2 j +2 + ....= a i i + j

2

i =0

Luego el proceso ser estacionario en la medida en que se cumplan estas tres condiciones:

Pgina 17

ADE Econometra II. Modelos de Series Temporales

___________________________________________________________________________________

E( a ) / = 1 y = k <

i

i=0

i=1

< / = 1

2

i

i=0

i+ j

<

i=0

Ventajas:

Una vez definido este proceso particular, vamos a ver resumidamente sus ventajas respecto a

no contar con l.

En principio, si quisieramos definir un proceso estocstico en general, tendramos, al menos,

que definir sus momentos de primer y segundo orden, para lo cual sera necesario estimar T varianzas,

T esperanzas y (T2 -T)/2 covarianzas, lo que nos es imposible si slo contamos con T datos.

Si el proceso fuera estacionario, ya slo tendramos que estimar una esperanza y una varianza

(media y una varianza constantes) y (T-1) covaria nzas (cov(yt,yt-1), cov(yt,yt-2), ...); en total 1+1+(T1)=T+1 parmetros, lo que tampoco es posible. Si estamos ante un proceso estocstico estacionario

lineal discreto, slo necesitaremos contar con:

T > p+ q + 2

siendo "p" y "q" los rdenes de los retardos de los modelos autorregresivos y de medias mviles que ya

hemos definido anteriormente.

MODELOS MA(1)

Una vez tenemos definidas las ventajas de contar con un proceso estocstico estacionario

lineal y discreto, y que podemos calcular las funciones de autocovarianza y autocorrelacin, puede

resultar interesante ver que valores toman stas en aquellos casos sencillos que luego nos permitan

comprobar si series econmicas generales pueden tener un comportamiento similar, simplemente

acudiendo a la comparacin de sus correlogramas (de la funcin de autocorrelacin total y parcial).

El primer caso a analizar ser el modelo de medias mviles de orden uno, que se define como:

y t = + a t + 1 a t -1

Este modelo tambin se puede escribir en funcin del operador retardo, ya comentado, del

siguiente modo:

Pgina 18

ADE Econometra II. Modelos de Series Temporales

___________________________________________________________________________________

yt = +(L) a t

/ (L) = 1 - 1 L

Se dice que un modelo MA(q) es invertible en la medida en que se pueda escribir como un

proceso autorregresivo de orden infinito. Para que esta circunstancia pueda darse, ser condicin

necesaria que las races de:

1 - (L) = 0

caigan fuera del crculo unitario, lo que se cumplir siempre que ||<1

Esta situacin proviene de la conversi n del modelo de medias mviles en modelo

autorregresivo. Si escribimos el MA(1) como:

y t = + a t + 1 a t -1

Podemos hacer sucesivas sustituciones hasta llegar al modelo autorregresivo:

a t -1 = yt -1 - - 1 at -2

y t = + ( y t -1 - - 1 a t - 2 ) + a t

y t = + at + 1 y t -1 - 1 - 12 y t.2 - .... =

= 1 yt -1 + 21 yt -2 + ...+ (1 +1 +12 + 31 + ...+ n1 -1 ) + at - 1n at -n

si n :

y t = yt -1 + 12 y t - 2 + ... +

1

+ at

1 -1

donde es necesario que ||<1 para que la progresin geomtrica que se produce sobre los

parmetros sea calculable y no explosiva.

El siguiente paso, una vez definida la condicin de invertibilidad, es definir las funciones que se

han descrito para los procesos estocsticos en general para el caso del modelo MA(1).

ADE Econometra II. Modelos de Series Temporales

Pgina 19

___________________________________________________________________________________

Esperanza:

E( yt ) = E( + at + 1 a t -1 ) = E( ) + E( at ) +1 E( at -1 ) =

Varianza:

var( yt ) = E( y t - )2 = E( + a t +1 at - 1 - )2

E( a 2t +12 a 2t -1 + 2 1 at a t -1 ) =

= 2a + 21 2a + 0 =

Funcin de autocovarianza:

1 = cov( y t , y t -1 ) = E(( y t - )( y t -1 - )) =

E(( at + 1 a t -1 )( a t -1 + 1 a t - 2 )) =

E( at a t -1 + 1 a t a t -2 + 1 a t -1 a t -1 + 21 a t -1 a t - 2 =

2

1 E( at -1 ) = 1 2a

j = cov( y t , y t - j ) = E(( y t - )( y t - j - )) =

E(( at + 1 a t -1 )( a t - j + 1 a t - j -1 )) =

= E( at a t - j + 1 a t -1 a t - j + 1 a t at - j -1 + 21 a t -1 a t - j -1 )

E( aT a t - j + 1 a t -1 a t - j + 1 a t at - j -1 + 21 a t -1 a t - j -1 ) = 0 = j

Luego la funcin de autocovarianza se anula para valores de "j" mayores que uno y es una

fracci n de la varianza del error para el valor de j=1.

Pgina 20

ADE Econometra II. Modelos de Series Temporales

___________________________________________________________________________________

Funcin de autocorrelacin:

Calculada como cociente entre la funcin de autocovarianza y la varianza, tal y como ya se

vio antes, tendramos:

j =

j

0

1 = 1 2a

j = 0

/j > 1

La funcin de autocorrelacin parcial se calculara siguiendo la siguiente expresin, que no

demostramos:

1 (1 - 1 )

jj =

1 - 21 ( j+1)

j

Definidas las funciones caractersticas de los procesos estocsticos para el caso concreto del

MA(1), podemos enunciar las siguientes particularidades de este tipo de proceso:

1.2.3.4.-

Siempre es estacionario.

Para ser invertible, es necesario que ||<1.

La j slo tiene un punto significativo. El modelo "olvida" la correlacin con perodos distintos

al inmediatamente anterior y el correlograma slo tendr un punto significativo.

La funcin de autocorrelacin parcial no se anula, pero tendr un comportamiento

amortiguado hacia cero.

MODELOS AR(1)

Definido el modelo AR(1) como:

y t = 0 + 1 yt -1 + a t

que tambin puede escribirse como:

(L) y t = 0 + at

(L) = 1 - 1 L

a diferencia de los modelos de medias mviles, los autorregresivos no son estacionarios por

definicin y, para que lo sean, ha de cumplirse que las races de la siguiente ecuacin sean mayores

que uno:

Pgina 21

ADE Econometra II. Modelos de Series Temporales

___________________________________________________________________________________

(L) = 1 - 1 L = 0

lo que nos permitira escribirlo como un modelo de medias mviles y, en definitiva, esto supone que los

coeficientes | | han de ser menores que 1.

Pasamos a describir las funciones definidas:

Esperanza matemtica:

E( yt ) = E(1 y t -1 + 0 + a t ) =

= 1 E( y t -1 + 0 + 0

donde, como el proceso es estacionario, las esperanzas E(yt)=E(yt-1)=...=E(yt-j)= y puedo escribir:

E( yt ) = = 1 + 0

=

0

1 - 1

Varianza:

Para hacer los clculos con mayor facilidad es conveniente poner el modelo autorregresivo en

desviaciones a la media, sin que ello suponga ningn cambio en ste (se puede hacer la prueba

escribiendo el modelo en desviaciones y llegando al modelo normal).

El modelo en desviaciones a la media lo definiremos como:

~

y t = 1 ~y t - 1 + at

donde:

~

y t - j = y t- j - = y t j - 0

1 - 1

Pgina 22

ADE Econometra II. Modelos de Series Temporales

___________________________________________________________________________________

Para calcular la varianza, escribimos el momento de segundo orden:

var( y t ) = 0 = E( 1 ~y t -1 + at )2

E( 21 y 2t -1 + at2 + 2 1 ~y t - 1 at ) =

21 E( ~

y t -1 )2 + E( a t )2 + 2 1 E( ~y t -1 at )

dado que el proceso es estacionario:

E( ~y t )2 = E( ~y t -1 )2 = 0

E( at )2 = 2a

como el proceso en desviaciones a la media se puede escribir como un proceso de medias

mviles y por lo que hemos visto anteriormente, podramos escribir:

E( at ~

y t -h ) = 2a /h = 0 y 0 si h > 0

Por todo lo cual:

0 = 21 0 + 2a

0 =

2a

1 - 12

Pgina 23

ADE Econometra II. Modelos de Series Temporales

___________________________________________________________________________________

Funcin de autocovarianza:

1 = cov( ~

y t ~y t -1 ) = E( ~y t -1 ( 1 ~

y t -1 + a t )) =

= 1 0 = 1 a 2

1 - 1

2

2 = cov( ~y t ~

y t -2 ) = E( ~y t -2 ( 1 ~y t -1 + a t )) =

2

1 = 12 0 = 21 a 2

1 - 1

Lo que generalizando, se podra escribir como:

j = a 2 1j

1 - 1

2

Funcin de autocorrelacin total

j = 1j /j 1

Funcin de autocorrelacin parcial

jj = 1 /j = 1 y 0 si j > 1

Definidas todas estas funciones, podemos caracterizar el proceso autorregresivo del siguiente

modo:

1.2.3.4.-

Siempre es invertible (est directamente invertido).

Para ser estacionario, ha de cumplirse que | |<1.

La funcin de autocorrelacin total no se anula, pero se va amortiguando hacia cero.

La funcin de autocorrelacin parcial se anula para retardos superiores a uno.

Pgina 24

ADE Econometra II. Modelos de Series Temporales

___________________________________________________________________________________

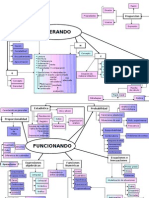

FAC

FAP

MA(q)

Se anula para retardos superiores a q

Decrecimiento rpido sin llegar a

anularse

AR(p)

Decrecimiento rpido sin llegar a

anularse

Se anula para retardos superiores a p

ARMA(

p,q)

Decrecimiento rpido sin llegar a

anularse

Decrecimiento rpido sin llegar a

anularse

IDENTIFICACIN DEL MODELO

Aunque podramos seguir definiendo las caractersticas de otros procesos ARIMA de rdenes

mayores, no tiene mayor inters una vez se ha entendido el procedimiento y s interesa precisar la

forma que adoptaran los correlogramas de estas funciones porque, fruto de su comparacin con los

que obtendremos con nuestras series de inters, podremos asociar a nuestra serie temporal de estudio

un proceso ARIMA que identifique su proceso generador de datos, tanto a pasado como a futuro.

Los correlogramas o funciones de autocorrela cin total y parcial estn disponibles en el libro

de Pulido,A(1989): "Prediccin Econmica y Empresarial" Editorial Pirmide.

De forma muy poco acadmica, el proceso de identificacin consistir en calcular las

funciones de autocorrelacin total y parcial de nuestra serie (una vez estamos seguros de que sta

cumple las condiciones que definen un proceso estocstico estacionario) y comparar sus

correlogramas con los correspondientes a los modelos tericos AR(p),MA(q) o ARMA(p,q).

En principio, si el proceso est bien identificado, procederemos a su estimacin y, si

analizamos los correlogramas de los residuos obtenidos en la estimacin, sern "ruido blanco". Si sto

no es as, habr que realizar una nueva estimacin incorporando la estructura ms parecida al modelo

terico que podamos intuir con la comparacin con los modelos tericos.

Para saber cuando estamos ante un "ruido blanco", se pueden hacer las siguientes

comprobaciones:

-

Media nula

Puede observarse en el grfico de residuos si el error se mueve en torno al valor cero o bien

calcularse el cociente entre la media y la varianza muestral de los residuos. Si ese ratio es inferior a 2,

podemos concluir (con un =0,05) que la media no es significativamente distinta de cero.

-

Varianza constante

Observando el grfico de los residuos puede analizarse la constancia de la varianza del error.

En caso de heterocedasticidad y es recomendable una transformacin logartmica en la serie original.

-

Incorrelacin

Deben observarse los coeficientes de autocorrelacin muestral de los residuos y comprobar

que ninguno de ellos supera el valor de las bandas de significatividad al 5% (1,96(1/T)).El valor Tes

una aproximacin de la varianza asinttica pero resulta slo adecuada para valores grandes de "j". Se

aconseja,por tanto, utilizar distinta amplitud de bandas como por ejemplo (1/T) para los trminos ms

cercanos a cero.

Pgina 25

ADE Econometra II. Modelos de Series Temporales

___________________________________________________________________________________

El estudio de las funciones de autocorrelacin muestral y autocorrelacin parcial muestral de

los residuos, pueden servirnos fcilmente para el replanteamiento del modelo inicial.

El contraste de la "Q" de Box-Pierce analiza la hiptesis nula de que:

H0: 1(a)= 2(a)= 3(a)=.......... M(a)=0

suponiendo que la expresin:

M

Q = T r 2j (a )t

j=1

o la alternativa propuesta por Ljung-Box:

M

*

-1

Q = T(T + 2) (T - j ) r 2j (a )t

j=1

se distribuye como una chi-cuadrado con M-k grados de libertad. Otros contrastes alternativos

son los de Vandaele (1983), que analiza las autocorrelaciones muestrales de los residuos

transformados mediante una diferencia regular y el de Pea (1983).

BREVE RESEA SOBRE LA ESTIMACIN DE LOS MODELOS ARIMA

Se analizar a continuacin el proceso de estimacin de los modelos ARMA(p,q) x

ARMA(P,Q), centrando los desarrollos en el caso especfico de un modelo sin componente estacional,

es decir, un ARMA(p,q) ARIMA (p,d,q):

(1 - 1 L - 2 L2 - ...... - p L p ) wt = + (1 - 1 L - 2 L 2 - ...... - q Lq ) at

donde se entiende por Wt la serie ya en diferencias y donde, como siempre, at se supone un

ruido blanco con media cero y varianza constante (2u).

Definida esta funcin genrica, el objetivo principal es estimar el vector formado por los

parmetros correspondientes a la parte autorregresiva j y de medias mviles j (incluido, si fuera

necesario, el trmino independiente) as como la varianza residual.

Problemas iniciales: los valores iniciales y la no linealidad.

La naturaleza del modelo implica que la variable a explicar se hace depender de valores

pasados de la misma y errores cometidos en la estimacin de dichos valores pasados. De esta forma

el planteamiento de minimizacin de los errores como procedimiento de estimacin lleva

necesariamente aparejada la necesidad de conocer valores pasados de la variable endgena y

Pgina 26

ADE Econometra II. Modelos de Series Temporales

___________________________________________________________________________________

de los errores ya que la expresin del error, por ejemplo para un perodo "t" sera:

a t = wt - 1 W t -1 - ... - p wt - p - +1 u t -1 - ... - q at -q

Al conjunto de valores iniciales requeridos de la variable endgena desde "t-1" a "t-p" y de los

errores desde "t-1" a "t-q" los notaremos por los vectores:

0

W = ( W t -1 ,W t -2 ,.....,W t - p )

a 0 = ( at -1 , at - 2 ,....., at - q )

El procedimiento de estimacin que lleva implcita la especificacin a priori de unos valores

iniciales se denomina "enfoque condicional", mientras que aquel en el que se estiman simultneamente

los valores iniciales y los parmetros se denomina "enfoque exacto".

Adems de este primer problema, se seala el de la no linealidad del modelo cuando este

incluye medias mviles, lo que puede comprobarse fcilmente a partir de una transformacin de la

especificacin de un modelo sencillo [por ejemplo MA(1)]:

Y t = a t - 1 a t -1 a t = Y t +1 at - 1

para t = 1 a1 = Y 1 +1 a0

para t = 2 a 2 = Y 2 + 1 a1 =

= Y 2 + 1 ( y 1 +1 a0 ) =

= Y 2 +1 Y 1 +12 a 0

Partiendo de esta expresin, se observa como al minimizar:

T

t=1

(3)

3

El trmino " T " hace referencia a los valores disponibles de la serie una vez tomadas diferencias tanto en la

componente regular (d) como en la estacional (D):

Pgina 27

ADE Econometra II. Modelos de Series Temporales

___________________________________________________________________________________

en el proceso de estimacin, esta expresin no ser lineal. Por ello, una primera conclusin es

que sea cual sea el mtodo de estimacin utilizado (Mnimos cuadrados o Mxima verosimilitud)

debern aplicarse algoritmos de resolucin no lineales.

PREDICTOR PTIMO.

"La prediccin es el fin ltimo y primordial del anlisis univariante de series temporales"4

Una vez identificado y estimado el modelo ARIMA, se plantea su utilizacin para conseguir la

mejor prediccin de los valores a futuro de una serie a partir de su propia historia. El primer

interrogante que surge se referir a la determinacin del PREDICTOR PTIMO para este fin.

Intuitivamente, el mejor predictor posible ser "el que menos se equivoca" o, en trminos

estadsticos, aquel que minimiza el error cuadrtico medio respecto a otro potencial predictor

alternativo. Esto se puede expresar:

E[( Y T +l - Y T (l) )2 | I T ] E[( Y T +l - Y *T (l) )2 | I T ]

donde YT (l) sera el valor de prediccin de la serie para el perodo (T+l), condicionado a los

valores histricos de YT (YT = YT-1,YT-2, ...).

Se demuestra que el predictor elegido es ptimo cuando su valor esperado es igual al valor

real de prediccin condicionado a la informacin existente en el perodo T respecto a la serie que nos

ocupa; es decir:

Y T (l) = E[ Y T +l | I T ]

El error cuadrtico medio de un predictor arbitrario siempre es mayor que aquel cuyo valor

coincide con la esperanza del valor real en el perodo que estemos considerando. Esta propiedad ser

fundamental para el posterior desarrollo de la prediccin puntual.

PREDICCIN PUNTUAL

Partiendo de un modelo ARIMA sobre el que se han realizado una serie de diferenciaciones

para lograr una serie estacionaria, el planteamiento de la prediccin se hace sobre los valores reales de

la serie, por entender que es de stos de los que se quiere obtener valores a futuro. Esta circunstacia

deber ser tomada en cuenta a la hora de interpretar los subndices que acompaan a las frmulas de

este apartado.

La aparicin de rdenes autorregresivos superiores a "p" ser debida a dos circunstancias:

traslacin del modelo a perodos fuera del espacio temporal conocido y aplicacin de las expresiones

T= N - d - sD

4

TRIVEZ,F.J. y AZNAR,A.: "Mtodos de prediccin en economa" Volumen II, Anlisis de series temporales"

Pgs.240-267. Editorial Ariel, 1993.

ADE Econometra II. Modelos de Series Temporales

Pgina 28

___________________________________________________________________________________

obtenidas para WT = (1 - L)d YT directamente a los valores de la serie sin transformar (sustituir WT

por su valor en cada caso).

En su forma ms general el modelo ARIMA(p,d,q) ARIMA(P,D,Q,) S podra escribirse como:

Y T = 1 Y T -1 +2 Y T - 2 + ...+ Ps+ p +Ds+d Y T - Ps- p - sD -d +

+ + aT + 1 a T -1 + ...+ Qs+q a T - sQ -q

El desarrollo terico se hace para un modelo sin parte estacional, sin que ello suponga prdida

de generalidad en los resultados. El modelo podra escribirse entonces como:

*p (L)W t = +*q (L) at

como sabemos que WT = (1 - L)d YT , la expresin anterior se puede reescribir como:

*p (L) Y t = +*q (L) a t

donde:

(L) Y T = 1 - 1 L - 2 L2 + ...+ p +d L p +d +

(L) = 1 - 1 L + ...+ q Lq

El modelo ARIMA correspondiente sera:

Y T = 1 Y T -1 +2 Y T - 2 + ...+ p +d Y T - p - d +

+ + aT +1 a T - 1+...+ q a T - q

En la medida en que aparece la perturbacin aleatoria en la definicin de cada valor de

prediccin de la serie YT , el modelo es susceptible de ser escrito como funcin infinita de los valores

de la perturbacin aleatoria del perodo considerado y de los anteriores (no habra ms que despejar el

valor de la perturbacin aleatoria de la expresin general de un modelo ARIMA).

Para hacer prediccin hay que tener en cuenta dos supuestos inciales:

1.-

Los parmetros de las funciones presentadas son conocidos.

2.-

Las perturbaciones aleatorias se conocen en el perodo muestral y tiene carcter de

Pgina 29

ADE Econometra II. Modelos de Series Temporales

___________________________________________________________________________________

ruido blanco para los perodos de prediccin.

Teniendo en cuenta ambos supuestos, se puede especificar un modelo ARIMA para definir el

valor de prediccin en funcin de la serie en "p" perodos anteriores (por la parte autorregresiva) y de

los "q" errores cometidos al estimar la serie en los "q" perodos previos (por la parte de las medias

mviles). Dado que son los valores reales aquellos sobre los que es verdaderamente interesante hacer

prediccin, se plantea la ecuacin de prediccin de un perodo (T+l) como:

Y(l) = 1 Y T (l - 1) +2 Y T + l -1 Y T (l) + ... +

+ l +1 Y T -l + ...+ p +d Y T +l - p -d + - l aT - l +1 a T -1 - ... - q aT +l -q

Es conveniente remarcar tres aspectos de la prediccin siguiendo esta formulacin:

- Los valores de prediccin se calculan de forma secuencial. Para hacer posible la aplicacin

de la parte autorregresiva del modelo en perodos distintos al primero de prediccin, se toma el valor

predicho en el inmediatamente anterior (YT (l-1)).

- Por la condicin necesaria para estar ante el predictor ptimo (el valor esperado de la serie

en el perodo de prediccin es igual al predicho si es ptimo), se demuestra que las perturbaciones

aleatorias empleadas en la prediccin son slo las de perodos anteriores, es decir:

aT+ j j 0

ya que se ha supuesto que en el perodo de prediccin, las perturbaciones aleatorias tienen

esperanza nula.

Para realizar las sucesivas predicciones de YT (l) tenemos que contar con unos valores para

aT , aT-1, ...aT+l-q . Como tales se tomarn:

a T + j = Y T + j - Y T + j - l (l) j 0

Las predicciones ARIMA son adaptativas y los resultados obtenidos para (T+l), con la

informacin disponible hasta el perodo T, son los mismos que las que obtendramos para el mismo

perodo tomando como base informativa hasta T-1, y aadiendo un trmino de error.

CARACTERSTICAS DE LAS PREDICCIONES REALIZADAS CON MODELOS

ARIMA

- Modelos AR(p): la prediccin tiende a (media del proceso) a medida que aumenta el

horizonte temporal de la prediccin.

- Modelos MA(q): dada la memoria limitada que caracteriza a estos procesos, la prediccin es

Pgina 30

ADE Econometra II. Modelos de Series Temporales

___________________________________________________________________________________

igual a (media del proceso) cuando el horizonte temporal de la prediccin es mayor que el orden del

proceso (q).

- Modelos ARMA(p,q): a partir de "q" perodos futuros la prediccin tie nde a (media del

proceso) a medida que aumenta el horizonte temporal de la prediccin.

- Modelos ARI(p,d) e IMA(d,q): la prediccin ya no tiende a sino que ser una lnea recta

que parte de Y(1) 88con pendiente igual a la media del proceso wT (serie resultante de las

transformaciones necesarias para hacerla estacionaria).

SELECCIN DE MODELOS

Si entendemos que una prediccin es mejor que otra cuando comete menor error, los criterios

de seleccin de modelos seran el error cuadrtico medio (ECM), error absoluto medio (EAM) y

error absoluto porcentual medio (EAPM). Estos indicadores se calcularan a perodo histrico, es

decir, se calcularan los valores que el modelo ofrece para las H ltimas observaciones y se

compararan con el valor real, del siguiente modo:

1

ECM(H) =

H

EAM(H) =

EAPM(H) =

1

H

2

T -H

l=1

1

H

1

(l)= [ y

H

| eT - H (l) |=

l =1

T - H +l

- y T - H (l) ] 2

l =1

1

H

| y

1

| eT -H (l) |

* 100 =

y T - H +l

H

l= 1

T -H +l

- y T - H (l) |

l =1

| yT -H +l - y T - H (l) |

* 100

yT - H +l

l =1

El problema es que estos indicadores no tienen en cuenta la estructura estocstica del modelo,

no informan sobre alguna caracterstica estocstic a supuesta sobre el perodo extramuestral.

ADE Econometra II. Modelos de Series Temporales

Pgina 31

___________________________________________________________________________________

ALGUNAS REFERENCIAS

AZNAR, A. Y TRIVEZ, F.J.(1993): Mtodos de Prediccin en Economa II. Anlisis de series

temporales

Editorial Ariel Economa, Barcelona 1993.

ESPASA, A. Y CANCELO, J.R. (1993): Mtodos cuantitativos para el anlisis de la coyuntura

Econmica

Alianza Editorial, Madrid 1993.

PULIDO, A. Y PREZ GARCA, J. (2001): Modelos Economtricos

Editorial Pirmide, Madrid 2001.

Enders, W. (1995). Applied Econometric Times Series.

John Wiley & Sons, Inc. United States.

Maha Casado, R (1999): Procedimientos de anlisis de la estacionariedad: Integracin y races

unitarias. Documento de trabajo Instituto de Prediccin Econmica LR Klein 99/1 (disponible en

http://www.uam.es/klein, documentos de trabajo.

You might also like

- Tabla Figuras Geometricas 5Document7 pagesTabla Figuras Geometricas 5ANGEL BLANCO100% (1)

- Pentominos para Aprender GeometríaDocument12 pagesPentominos para Aprender GeometríaManuel Lara100% (1)

- 3.metodo SimplexDocument22 pages3.metodo SimplexMadeley UgarteNo ratings yet

- Elementos Geométricos Que Integran El Alineamiento VerticalDocument6 pagesElementos Geométricos Que Integran El Alineamiento VerticalJonathan Bryan VargasNo ratings yet

- Cap 9Document18 pagesCap 9Vsqz KellyNo ratings yet

- Capitulo 07Document44 pagesCapitulo 07Priscilla Zavaleta RuizNo ratings yet

- ApuntesDocument80 pagesApuntesVsqz KellyNo ratings yet

- Lectura Descomposicic3b3n Multiplicativa y Mc3a9todos de Suavizamiento 12 Feb 2013Document41 pagesLectura Descomposicic3b3n Multiplicativa y Mc3a9todos de Suavizamiento 12 Feb 2013Vsqz KellyNo ratings yet

- 1 - 3 Andrés Pueyo, A (2008)Document69 pages1 - 3 Andrés Pueyo, A (2008)Vsqz KellyNo ratings yet

- Convocatoria FISCALIZADORES DE LOCAL DE VOTACIÓNDocument4 pagesConvocatoria FISCALIZADORES DE LOCAL DE VOTACIÓNEscuela Educacion UpaoNo ratings yet

- 01 FORMULAS PROPOSICIONALES-Parte2Document24 pages01 FORMULAS PROPOSICIONALES-Parte2Luis Fernando Huanca VargasNo ratings yet

- Plan + Taller Matemã¡tico 4Document35 pagesPlan + Taller Matemã¡tico 4Angelica GarciaNo ratings yet

- Geometria PrimeroDocument12 pagesGeometria PrimeroHugo Ricardo Flores EncarnacionNo ratings yet

- Algebra LinealDocument7 pagesAlgebra LinealLUIS ALBERTO BASTO ACOSTANo ratings yet

- Como Se Hace Curva de Lorenz y GiniDocument23 pagesComo Se Hace Curva de Lorenz y GiniEnzo Sandoval P83% (6)

- Práctica 1 (2022-I) - SoluciónDocument28 pagesPráctica 1 (2022-I) - SoluciónSARAITH BRIGHITE COCHACHI URETANo ratings yet

- Leyes de InecuacionesDocument5 pagesLeyes de Inecuacionesll_luiguiNo ratings yet

- Metodo Simplex y Metodo GraficoDocument7 pagesMetodo Simplex y Metodo GraficoBraulio SilvaNo ratings yet

- Salud Pública - Tasa y ProporciónDocument9 pagesSalud Pública - Tasa y ProporcióntarjadanamarthNo ratings yet

- Factorización Parte 2Document11 pagesFactorización Parte 2Joaquin Chila FNo ratings yet

- T1 Magnitudes Físicas 201920Document24 pagesT1 Magnitudes Físicas 201920asinNo ratings yet

- Examen de Becas Carrion Con ClavesDocument3 pagesExamen de Becas Carrion Con ClavesPre Universitaria Carrion100% (1)

- 00191Document12 pages00191DeskartesNo ratings yet

- Quiz integrales fraccionesDocument7 pagesQuiz integrales fraccionesLeydhi Tatiana Holguin VargasNo ratings yet

- Ejercicio 5Document8 pagesEjercicio 5carlos andres jaramilloNo ratings yet

- Act. 3 17-20 MayoDocument4 pagesAct. 3 17-20 MayoJesús Franco SerranoNo ratings yet

- Problemas Con Razones para Tercero de SecundariaDocument3 pagesProblemas Con Razones para Tercero de SecundariaFernandaRamirezNo ratings yet

- Práctica 6 - Gauss Jordan Descomposición LUDocument5 pagesPráctica 6 - Gauss Jordan Descomposición LUMayra Rivas VillaNo ratings yet

- Definiciones de MatrizDocument32 pagesDefiniciones de MatrizLUZ BETZABE QUISPE PEÑANo ratings yet

- Distribución Normal: guía completa sobre su representación, cálculo de probabilidades y ejemplosDocument16 pagesDistribución Normal: guía completa sobre su representación, cálculo de probabilidades y ejemplosRuben Dario Lopez GutierrezNo ratings yet

- Álgebra LinealDocument26 pagesÁlgebra LinealHersson D AlemanNo ratings yet

- Contenidos Tercer Ciclo EGBDocument4 pagesContenidos Tercer Ciclo EGBmarugifNo ratings yet

- Tarea1 Esneider JiménezDocument13 pagesTarea1 Esneider JiménezEsneider JimenezNo ratings yet

- Poblacion y MuestraDocument31 pagesPoblacion y Muestrarenzo inquilla chambillaNo ratings yet

- Señales SingularesDocument19 pagesSeñales Singularesrasel palaciosNo ratings yet

- 01 Precalculo SistemasNumericosDocument9 pages01 Precalculo SistemasNumericosbsarmiento65No ratings yet