Professional Documents

Culture Documents

Perceptron

Uploaded by

Ceper0 ratings0% found this document useful (0 votes)

5 views2 pagesPerceptron

Copyright

© © All Rights Reserved

Available Formats

DOCX, PDF, TXT or read online from Scribd

Share this document

Did you find this document useful?

Is this content inappropriate?

Report this DocumentPerceptron

Copyright:

© All Rights Reserved

Available Formats

Download as DOCX, PDF, TXT or read online from Scribd

0 ratings0% found this document useful (0 votes)

5 views2 pagesPerceptron

Uploaded by

CeperPerceptron

Copyright:

© All Rights Reserved

Available Formats

Download as DOCX, PDF, TXT or read online from Scribd

You are on page 1of 2

Perceptrón

Es un tipo de red neural artificial. También puede entenderse como perceptrón la

neurona artificial y unidad básica de inferencia en forma de discriminador lineal.

Éste consiste en una suma de las señales de entrada, multiplicadas por unos

valores de pesos escogidos inicialmente en forma aleatoria. En una fase en la que

éste aprende, la entrada se compara con un patrón preestablecido para

determinar la salida de la red. Si en la comparación la suma de las entradas

multiplicadas por los pesos es mayor o igual que el patrón preestablecido, la salida

de la red es uno (1); en caso contrario la salida es cero (0). El perceptrón es un

dispositivo que, en su configuración inicial, no está en capacidad de distinguir

patrones de entrada muy complejos, sin embargo, mediante un proceso de

aprendizaje es apto para adquirir esta capacidad.

En esencia, el entrenamiento implica un proceso de refuerzo a través del cual los

pesos que codifican las sinapsis se incrementan o se disminuyen.

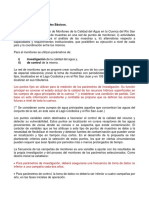

En la figura 2 se representa una neurona “artificial”, la cual intenta modelar el

comportamiento de la neurona biológica. Aquí el cuerpo de la neurona se

representa como un sumador lineal de los estímulos externos zj, seguida de una

función no lineal yj 5 f (zj). La función f (zj) es llamada la función de activación y es

la función que utiliza la suma de estímulos para determinar la actividad de salida

de la neurona.

Este modelo es la base de la mayoría de las arquitecturas de las RNA que se

interconectan entre sí.

Las neuronas emplean funciones de activación diferentes según la aplicación.

Algunas veces son funciones lineales, otras son funciones sigmoidales (por

ejemplo, la tanh x) y otras son funciones de umbral de disparo. La eficiencia

sináptica se representa por factores de peso de interconexión wij , desde la

neurona i hasta la neurona j.

Los pesos pueden ser positivos (excitación) o negativos (inhibición). Los pesos

junto con las funciones f (z) dictan la operación de la red neural. Normalmente las

funciones no se modifican de tal manera que el estado de la red neural depende

del valor de los factores de peso (sinapsis) que se aplica a los estímulos de la

neurona. En un perceptrón, cada entrada se multiplica por el peso w

correspondiente y los resultados se suman, siendo evaluados contra el valor de

umbral; si el resultado es mayor al mismo, el perceptrón se activa.

El perceptrón sólo es capaz de resolver funciones defi nidas por dos dimensiones.

Un ejemplo de una función que no puede ser resuelta es el operador lógico. El

entrenamiento de un perceptrón es por medio de la regla de aprendizaje delta:

Para cada peso w se realiza un ajuste dw según la regla:

dw = η(x - Y)X

Donde η es la razón de aprendizaje, y el valor deseado, Y el valor obtenido y X la

entrada aplicada

al perceptrón.

Figura 2. Estructura del perceptrón, la más simple en las RNA. Es un discriminador

binario lineal y puede ser entrenado para mejorar su desempeño. Las entradas de

la neurona (5A), los pesos aleatorios (5B), la sumatoria de la multiplicación de los

pesos por sus respectivas entradas (5C) y la salida que es el cálculo de todos los

pesos y sus entradas (5D).

You might also like

- ServicenDocument1 pageServicenCeperNo ratings yet

- MoodleDocument2 pagesMoodleCeperNo ratings yet

- Normas EIADocument8 pagesNormas EIACeperNo ratings yet

- Presencia & Dirección de O.E.MDocument7 pagesPresencia & Dirección de O.E.MCeperNo ratings yet

- AplicaciónDocument3 pagesAplicaciónCeperNo ratings yet

- Conclusiones Practica2 LinealDocument1 pageConclusiones Practica2 LinealCeperNo ratings yet

- Gonzalez CamaDocument6 pagesGonzalez CamaCeperNo ratings yet

- Examen AntropologiaDocument3 pagesExamen AntropologiacelpemoiNo ratings yet

- 4.4.1 Modelo de MintzbergDocument8 pages4.4.1 Modelo de MintzbergLizbeth GaliciaNo ratings yet

- Guia Basica MinecraftDocument3 pagesGuia Basica MinecraftEduardo ContrerasNo ratings yet

- Diferencias entre redacción y administraciónDocument3 pagesDiferencias entre redacción y administraciónVíctor ReyssNo ratings yet

- Material de Estudio (Logica)Document16 pagesMaterial de Estudio (Logica)F Carla Chambi RojasNo ratings yet

- Zoo La Granja BaezaDocument2 pagesZoo La Granja BaezaDiego Patricio Piñan EgasNo ratings yet

- Retardos Dinamica de SistemasDocument51 pagesRetardos Dinamica de SistemasDennisMauricioAvilésOdar100% (1)

- Formatos de Hojas de ControlDocument7 pagesFormatos de Hojas de ControlEsteban Huamani RojasNo ratings yet

- Unidad 1 RefrigeracionDocument16 pagesUnidad 1 RefrigeracionNuñez Zamora IrvingNo ratings yet

- Cap. 04 MulticolinealidadDocument25 pagesCap. 04 MulticolinealidadLisbeth Evelyn Huaman LaurenteNo ratings yet

- Biólogos de HondurasDocument10 pagesBiólogos de HondurasBenigno Reyes LagosNo ratings yet

- Schumpeter, Joseph, Diez Grandes Economistas. Capítulo 4Document23 pagesSchumpeter, Joseph, Diez Grandes Economistas. Capítulo 4Ricardo RamírezNo ratings yet

- Actividad 5 Día 1 Personal Social 3°Document3 pagesActividad 5 Día 1 Personal Social 3°Leonard Nilz Agui PerezNo ratings yet

- Canbus Dspic (Segunda Versión 02-04-2010)Document37 pagesCanbus Dspic (Segunda Versión 02-04-2010)Ojeda Juan100% (1)

- 12 Ejemplos de Vicios y Asertividad en La ComunicaciónDocument3 pages12 Ejemplos de Vicios y Asertividad en La ComunicaciónLourdes ParedesNo ratings yet

- La esencia de lo humano: la reflexión histórica y la construcción del otroDocument3 pagesLa esencia de lo humano: la reflexión histórica y la construcción del otrojcaro26100% (1)

- Cna 8vo 001 1 - 102001Document5 pagesCna 8vo 001 1 - 102001JOSE LUIS BOHORQUEZ VARGASNo ratings yet

- Instalación Geomembrana Canales MinaDocument36 pagesInstalación Geomembrana Canales MinaAlfonso Leonardo67% (3)

- Acta recepción obra mejoramiento transitabilidad Av. Deán ValdiviaDocument6 pagesActa recepción obra mejoramiento transitabilidad Av. Deán ValdiviaJose Luis Gallegos RamosNo ratings yet

- Guía Proceso de EscrituraDocument2 pagesGuía Proceso de EscrituraSebastián Pröschle AntinopayNo ratings yet

- Linea de Tiempo. Psicologia General I.Document2 pagesLinea de Tiempo. Psicologia General I.darkis100% (4)

- Ah 51Document98 pagesAh 51Vanessa Rodriguez100% (1)

- Estudio de caso SENA: La oportunidad de formarse gratis y flexibleDocument3 pagesEstudio de caso SENA: La oportunidad de formarse gratis y flexibledaddy el papi lolNo ratings yet

- Tutoria Dejamos La Colera y Recogemos La AlegriaDocument5 pagesTutoria Dejamos La Colera y Recogemos La AlegriaRosa Irene Cruz MartínezNo ratings yet

- Plan de Monitoreo de Calidad de AguaDocument12 pagesPlan de Monitoreo de Calidad de Aguaroger bolivarNo ratings yet

- Guía completa de normas APA 7a ediciónDocument7 pagesGuía completa de normas APA 7a ediciónCristina Maritza Villacreses LopezNo ratings yet

- Elementos Del Mundo NarradoDocument19 pagesElementos Del Mundo NarradoludimNo ratings yet

- Dr Atl La Nube ArteDocument4 pagesDr Atl La Nube ArteLuis ArandaNo ratings yet

- Control de Velocidad Disc Re To Deun MotorDocument0 pagesControl de Velocidad Disc Re To Deun MotorGilberto CarrilloNo ratings yet

- Qué es el Presupuesto ParticipativoDocument2 pagesQué es el Presupuesto ParticipativoGutierrez Rojas Elio WilyNo ratings yet